L’intelligence artificielle ne se contente plus de répondre. Elle commence à agir. Si les dernières années ont été marquées par l’émergence de modèles de langage capables de disserter sur n’importe quel sujet, une transition majeure s’opère actuellement sous nos yeux : l’agent IA. Nous passons de l’IA conversationnelle, qui attend sagement une consigne, à l’IA « agentique », capable de prendre des initiatives pour atteindre un objectif complexe. Pour les décideurs et les organisations, comprendre cette nuance n’est pas une simple coquetterie technique, c’est saisir la prochaine grande mutation du travail et de la stratégie numérique.

Définir l'agent IA : de l'outil à l'acteur

Qu’est-ce qu’un agent IA, concrètement ? Imaginons la différence entre un manuel de cuisine et un chef à domicile. Le manuel contient le savoir, mais il reste inerte tant que vous ne tournez pas les pages. Le chef, lui, évalue les ingrédients disponibles, ajuste le feu, goûte et rectifie l’assaisonnement de lui-même.

Un agent IA fonctionne de la même manière. Contrairement à un simple assistant IA, l’agent possède une forme d’autonomie. Il ne se contente pas de prédire le mot suivant ; il utilise un cycle de raisonnement pour planifier des tâches, utiliser des outils externes et évaluer ses propres résultats.

Cette capacité repose sur une architecture en boucle. L’agent reçoit une mission (« Organise un voyage d’affaires à Berlin en respectant mon budget »), il décompose cette demande en sous-tâches (recherche de vols, réservation d’hôtel, vérification des horaires de train), puis il exécute ces actions en interagissant avec des API ou des logiciels tiers.

Si un vol est complet, il ne s’arrête pas : il cherche une alternative. C’est cette boucle de rétroaction qui définit l’essence même de l’agentivité.

La typologie des agents : une hiérarchie de complexité

Tous les agents ne se valent pas. Leur sophistication dépend de leur capacité à traiter l’incertitude et à mémoriser des contextes longs.

Les agents de réflexe simple

Ce sont les ancêtres. Ils fonctionnent sur une base de règles « Si-Alors ». Si un client demande un remboursement, l’agent vérifie la date ; si elle est inférieure à 30 jours, il envoie un formulaire. Leur portée est limitée car ils ne comprennent pas l’intention profonde, seulement les mots-clés.

Les agents basés sur des modèles et des objectifs

Ici, l’IA possède une représentation interne du monde. Elle sait que si elle réserve un vol, elle doit aussi prévoir le trajet vers l’aéroport. Elle travaille pour atteindre un état futur souhaité. C’est le cœur des assistants personnels intelligents que nous voyons émerger aujourd’hui.

Les systèmes multi-agents (MAS)

C’est sans doute la frontière la plus passionnante. Imaginez plusieurs agents spécialisés qui collaborent. Un agent « codeur » écrit un script, un agent « testeur » vérifie les erreurs, et un agent « manager » coordonne le tout. Cette collaboration permet de résoudre des problèmes d’une complexité que même les plus grands modèles de langage ne pourraient gérer seuls.

Avantages et performances : pourquoi franchir le pas ?

L’intérêt pour un agent IA ne relève pas d’une mode passagère, mais d’une recherche d’efficacité opérationnelle sans précédent. Le premier gain est celui de la charge mentale. En déléguant non pas une tâche, mais un projet entier, l’humain se repositionne comme superviseur plutôt qu’exécutant.

La performance de ces systèmes se mesure à leur capacité de « raisonnement en chaîne de pensée ». En décomposant un problème, l’agent réduit le taux d’erreur. Les entreprises qui intègrent ces solutions constatent souvent une accélération drastique des cycles de décision.

Là où une analyse de marché prendrait trois jours à une équipe humaine, un système agentique peut compiler, synthétiser et extraire des recommandations en quelques minutes, en consultant des sources de données en temps réel.

Qualité et fiabilité : le défi de la confiance

Pourtant, l’autonomie apporte son lot d’incertitudes. Comment s’assurer que l’agent ne va pas « halluciner » ou prendre une décision absurde ?

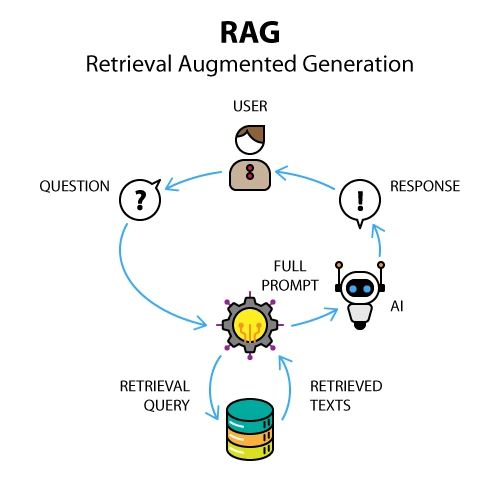

La qualité d’un agent IA dépend de son ancrage dans le réel. On utilise pour cela des techniques comme le RAG (Retrieval-Augmented Generation), qui force l’IA à baser ses réponses sur des documents internes vérifiés plutôt que sur ses propres probabilités statistiques.

La surveillance humaine reste cruciale. On parle souvent de « Human-in-the-loop » : l’agent prépare le travail, mais l’humain valide les étapes critiques.

Cette collaboration hybride garantit que la créativité et la vitesse de l’IA ne s’affranchissent jamais des valeurs et de la direction stratégique de l’organisation.

Schema RAG (Retrieval Augmented Generation)

Risques, limites et confidentialité : le revers de la médaille

L’adoption des agents soulève des questions de sécurité majeures. Puisqu’un agent IA a le pouvoir d’agir (envoyer des emails, déplacer des fonds, modifier des fichiers), une faille dans son code ou une consigne malveillante pourrait avoir des conséquences physiques ou financières réelles.

• Le détournement de consigne (Prompt Injection) : Un utilisateur malintentionné pourrait donner un ordre contradictoire à l’agent pour lui faire contourner ses règles de sécurité.

• La confidentialité des données : Pour être efficace, un agent doit souvent accéder à des données sensibles (emails, bases de données clients). Le risque de fuite vers les serveurs du fournisseur d’IA est une préoccupation légitime. Les solutions actuelles s’orientent vers des déploiements locaux ou des « clouds souverains » pour garantir que les données ne sortent jamais du périmètre de l’entreprise.

• La perte de contrôle : Un agent trop autonome pourrait optimiser un objectif au détriment du bon sens, un phénomène connu sous le nom d’alignement de l’IA.

L'intégration stratégique : par où commencer ?

Pour un responsable d’entreprise, l’intégration des agents doit être progressive. Inutile de chercher à automatiser l’intégralité de la chaîne de valeur dès le premier jour.

La stratégie gagnante consiste à identifier des processus répétitifs mais à haute valeur ajoutée.

Le support client, la veille concurrentielle ou la gestion des stocks sont des terrains fertiles. L’enjeu est de construire une infrastructure où l’IA ne remplace pas l’employé, mais devient son « copilote » dédié. Cela demande une montée en compétences des équipes, qui doivent apprendre non plus à utiliser un logiciel, mais à diriger une entité numérique.

Conclusion

L’agent IA marque la fin de l’ère de l’outil passif. Nous entrons dans une période où nos environnements numériques seront peuplés de collaborateurs synthétiques capables de raisonner et d’agir. Si les promesses de productivité sont vertigineuses, la responsabilité des décideurs est de bâtir un cadre éthique et sécurisé pour ces nouveaux venus. L’avenir appartient à ceux qui sauront orchestrer cette intelligence, en gardant à l’esprit que l’autonomie de la machine doit toujours servir la vision de l’humain.

Souhaitez-vous que je développe un cas d’usage spécifique pour votre secteur d’activité ou que j’approfondisse les protocoles de sécurité liés aux agents ?