Vous avez déjà posé une question à une IA et reçu une réponse qui avait l’air très sûre d’elle… jusqu’au moment où vous réalisiez qu’elle venait de tout inventer ? C’est le problème numéro un de l’IA collaborative appliquée à la recherche d’information : un modèle seul, aussi puissant soit-il, reste un modèle seul. Microsoft vient de décider que c’était exactement le problème à régler — et sa solution, c’est de faire bosser plusieurs IA ensemble, en équipe, chacune avec son rôle.

Critique : une approche d'IA collaborative inspirée du monde académique

L’idée est simple, presque évidente à formuler. Dans le monde académique, une publication ne sort pas sans relecture par un pair. Pourquoi une IA devrait-elle faire exception ? C’est le raisonnement derrière « Critique », la nouvelle fonctionnalité intégrée à Researcher, le module de recherche avancée de Microsoft Copilot.

Concrètement : le modèle de type GPT, développé par OpenAI, produit une première version de la réponse. Ensuite, l’IA Claude, conçue par Anthropic, passe cette réponse au crible, vérifiant la cohérence des informations. Ce n’est pas une IA qui surveille l’autre par défiance — c’est une architecture pensée pour créer une boucle de rétroaction. Chaque modèle fait ce qu’il fait de mieux, et le résultat est censé être meilleur que la somme de ses parties.

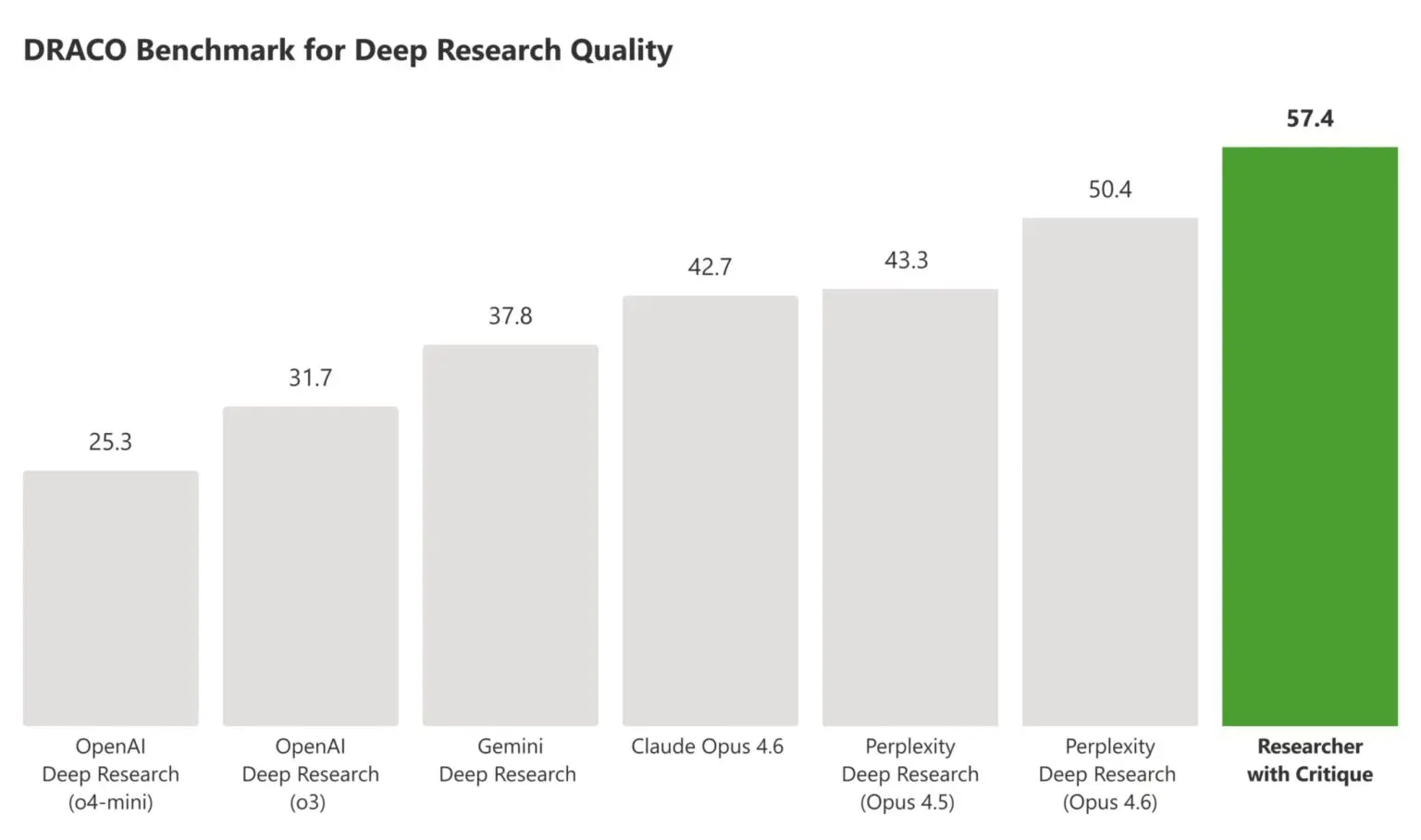

Ça peut sembler gadget dit comme ça. Mais les chiffres avancés par Microsoft sont assez nets : l’entreprise indique une progression de 13,8 % sur le benchmark DRACO, un outil qui mesure la qualité des recherches approfondies selon plusieurs critères, comme l’exactitude ou l’objectivité. Ce n’est pas rien — surtout sur un benchmark conçu pour aller bien au-delà de la simple fluidité de la réponse.

Model Council : l'IA collaborative poussée jusqu'à la transparence

Certains utilisateurs préfèrent garder la main, ne pas se laisser imposer une synthèse prédigérée. Pour eux, Microsoft a prévu autre chose : le « Model Council ». Ce dispositif permet d’obtenir deux analyses distinctes, chacune générée par un modèle différent. L’utilisateur peut alors consulter deux rapports séparés issus des modèles, mais aussi une synthèse qui met en avant les points de convergence et de divergence.

C’est une approche radicalement différente, et franchement plus honnête intellectuellement. Plutôt que de vous livrer une vérité unique et lissée, Microsoft vous expose les désaccords. Deux IA qui arrivent à des conclusions différentes sur le même sujet — c’est une information en soi. Ça vous dit quelque chose sur la nature ambiguë du sujet, et ça force à réfléchir plutôt qu’à avaler.

Cette transparence permet non seulement de mieux comprendre les biais ou différences d’interprétation entre modèles, mais aussi de renforcer la confiance dans les résultats. Et ça, c’est une promesse que peu d’outils IA ont eu l’audace de faire jusqu’ici.

Ce que ça dit du secteur en général

Microsoft n’est pas seul à explorer cette direction. Des acteurs comme Mistral AI ont lancé des systèmes d’agents spécialisés qui collaborent et se consultent, et Cloudflare propose des frameworks pour orchestrer des agents IA indépendants qui communiquent entre eux. L’IA collaborative est en train de devenir un vrai axe de développement dans le secteur, pas juste un argument marketing.

Ce qui est intéressant ici, c’est le signal que ça envoie : le modèle unique tout-puissant touche peut-être ses limites. Pas en termes de puissance brute, mais en termes de fiabilité et de transparence. Faire bosser des IA concurrentes — OpenAI d’un côté, Anthropic de l’autre — pour produire de meilleurs résultats ensemble, c’est un peu comme réunir deux équipes rivales sur le même projet. Ça demande de l’humilité côté éditeur, et ça mérite d’être noté.

Alors, révolution ou gadget ?

Ces innovations sont disponibles dans le programme Frontier de Microsoft 365 Copilot, pour l’instant réservées aux utilisateurs les plus avancés. On n’est pas encore sur un déploiement grand public massif — c’est un avant-goût, une bêta.

Reste à voir si ce modèle d’IA collaborative tiendra ses promesses à grande échelle. Les résultats sur DRACO sont encourageants, le concept est solide. Mais la vraie question n’est pas technique — elle est humaine. Est-ce qu’on est prêts à faire confiance à un système qui nous montre ses doutes, ses divergences, ses zones d’ombre ? Ce serait une belle évolution. Une IA qui assume ses limites, c’est paradoxalement plus crédible qu’une IA qui prétend tout savoir.